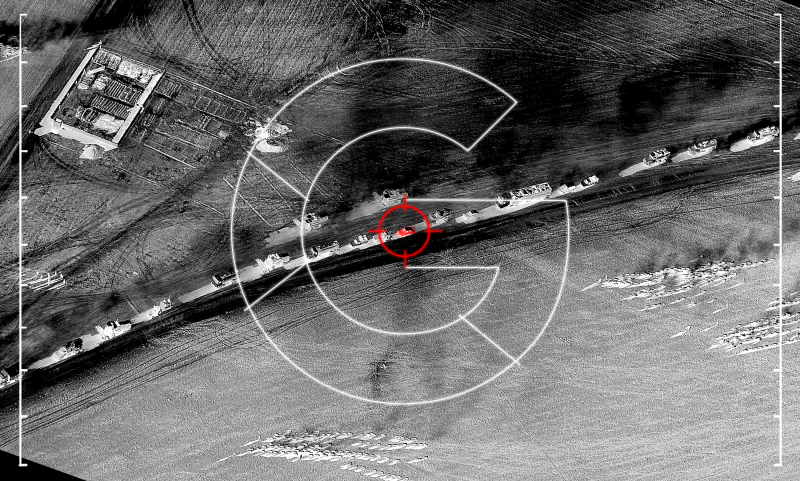

Début mars, il a été porté à la connaissance du public que Google travaillait secrètement avec le Pentagone sur Maven, qui fait référence à un projet d'intelligence artificielle à des fins militaires. Il s'agit en effet d'un projet qui vise à améliorer les opérations de drones en utilisant des technologies de reconnaissance d'images. Selon le Pentagone, l'objectif initial de Maven était de fournir à l'armée une vision par ordinateur avancée, permettant la détection et l'identification automatique d'objets, dans pas moins de 38 catégories, capturés par la caméra d'un drone. Il va par conséquent permettre de suivre à la trace certaines cibles, pour éventuellement mener des frappes.

Début mars, il a été porté à la connaissance du public que Google travaillait secrètement avec le Pentagone sur Maven, qui fait référence à un projet d'intelligence artificielle à des fins militaires. Il s'agit en effet d'un projet qui vise à améliorer les opérations de drones en utilisant des technologies de reconnaissance d'images. Selon le Pentagone, l'objectif initial de Maven était de fournir à l'armée une vision par ordinateur avancée, permettant la détection et l'identification automatique d'objets, dans pas moins de 38 catégories, capturés par la caméra d'un drone. Il va par conséquent permettre de suivre à la trace certaines cibles, pour éventuellement mener des frappes.Google s'est défendu en expliquant que l'entreprise a depuis longtemps travaillé avec des agences du gouvernement américain pour leur fournir des solutions technologiques. Et d'ajouter que son travail sur le projet Maven est « non offensif », car la technologie ne sera pas utilisée pour des frappes ciblées. Les employés de l'entreprise n'ont toutefois pas vu cette situation de la même manière et ont lancé un mouvement de contestation en interne.

Début avril, des milliers d'employés de Google ont signé une lettre pour protester contre l'implication de l'entreprise dans le programme du Pentagone, ce qui pourrait, selon eux, salir de manière irrémédiable l'image de l'entreprise et réduire sa capacité à rivaliser avec les autres géants de la technologie pour attirer les talents. A cela, s'est ajoutée la démission récente d'une douzaine d'employés de Google en signe de protestation.

Trois mois depuis le début de l'affaire, une nouvelle fuite d'emails internes nous révèle que Google avait bien conscience du terrain sur lequel l'entreprise s'aventurait, mais semblait se préoccuper plus de l'opportunité qui se présentait à elle avec le projet Maven. D'après les emails datant de septembre et obtenus par The Intercept, le projet Maven, pour le début, ne semblait pas être un gros contrat : juste une affaire de 25 à 30 millions de dollars selon les emails. Mais au fur et à mesure que le programme allait se développer, Google pourrait empocher jusqu'à 250 millions de dollars par an, expliquait Aileen Black, une des responsables de l'équipe de ventes de Google. Elle affirme en effet que le projet Maven était « directement lié » à un important contrat de cloud computing de plusieurs milliards de dollars et pour lequel les entreprises de la Silicon Valley étaient en compétition. Le contrat concernait « le déplacement agressif du Département américain de la Défense vers le cloud », a-t-elle écrit.

Selon The Intercept, Black faisait référence à la Joint Enterprise Defense Infrastructure (JEDI), un contrat de 10 milliards de dollars sur dix ans et pour lequel Google a manifesté un intérêt. Le programme JEDI a été annoncé le 12 septembre.

D'autres entreprises technologiques telles qu'Amazon étaient en lice, aurait écrit un responsable de Google impliqué dans les négociations. Les emails ont révélé en outre qu'Amazon Web Services, la branche de cloud computing d'Amazon, « a des charges de travail » liées au projet Maven. Google n'avait donc pas intérêt à négliger le projet de drone militaire du Pentagone, mais l'entreprise craignait aussi la réaction du public si sa collaboration avec le Pentagone était divulguée. Google se demandait alors s'il fallait ou non révéler l'accord.

Fei-Fei Li, la chief scientist de la branche IA et machine learning de Google Cloud, a toutefois averti cette affaire donnerait aux médias une occasion de s'acharner sur l'entreprise. « Vous avez probablement entendu Elon Musk et son commentaire selon lequel l'IA provoquerait la troisième guerre mondiale », a-t-elle écrit. « Je ne sais pas ce qui se passerait si les médias commençaient à écrire sur le fait que Google construisait secrètement des armes d'IA ou des technologies IA pour les armes de l'industrie de la Défense », a-t-elle ajouté.

Aileen Black a toutefois essayé de les convaincre dans les discussions internes : « Le contrat n'est pas direct avec Google, mais par le biais d'un partenaire (ECS) et nous avons des conditions qui empêchent les communiqués de presse de se passer sans notre consentement mutuel », a écrit Black. Le département de la Défense « ne dira rien sur Google sans notre approbation », a-t-elle assuré.

Mais cela ne pourrait rester pendant longtemps un secret, et Aileen Black en était consciente. Elle a averti que les nouvelles finiront par être divulguées, par exemple, à travers une requête en vertu du Freedom of Information Act pour obtenir les informations sur le processus de passation de marchés. L'implication de Google dans le projet Maven « finira par sortir », a-t-elle prévenu. Elle a donc jugé qu'il serait approprié pour Google d'annoncer lui-même le contrat, avant que cela soit divulgué d'une autre manière.

L'entreprise n'avait aucun plan de presse pour l'annonce du contrat et a convenu qu'elle devrait travailler pour trouver un « récit » le plus rapidement possible. Mais le projet Maven n'a pas été annoncé publiquement jusqu'à ce que la nouvelle parvienne aux oreilles des médias au mois de mars.

Amazon, qui est cité dans l'affaire, n'a pas répondu à la demande de commentaire de The Intercept. Google Cloud, à travers un porte-parole, a pour sa part rappelé dans un email que la société travaille sur la rédaction de nouveaux principes qui empêchent l'utilisation de l'IA dans l'armement. L'entreprise est toutefois restée silencieuse sur les nouvelles révélations.

Source : The Intercept

Et vous ?

Que pensez-vous de ces nouvelles révélations ?

Que pensez-vous de ces nouvelles révélations ? Croyez-vous que n'importe quelle autre entreprise aurait pris la même décision que Google ?

Croyez-vous que n'importe quelle autre entreprise aurait pris la même décision que Google ?Voir aussi :

L'intelligence artificielle pourrait mener à la troisième guerre mondiale : un nouvel épisode d'Elon Musk après la déclaration de Vladimir Poutine

L'intelligence artificielle pourrait mener à la troisième guerre mondiale : un nouvel épisode d'Elon Musk après la déclaration de Vladimir Poutine  L'intelligence artificielle : clé du futur pour dominer sur les nations, d'après le président russe, Vladimir Poutine

L'intelligence artificielle : clé du futur pour dominer sur les nations, d'après le président russe, Vladimir Poutine  Mark Zuckerberg pense que les prédictions d'Elon Musk sur l'IA sont irresponsables, le PDG de Tesla serait-il un peu trop pessimiste ?

Mark Zuckerberg pense que les prédictions d'Elon Musk sur l'IA sont irresponsables, le PDG de Tesla serait-il un peu trop pessimiste ?  Elon Musk appelle les Nations Unies à bannir les robots tueurs dans une lettre ouverte signée par 116 spécialistes de l'IA et la robotique

Elon Musk appelle les Nations Unies à bannir les robots tueurs dans une lettre ouverte signée par 116 spécialistes de l'IA et la robotique  Robots militaires : les États-Unis testent l'efficacité de leurs prototypes dans le Pacifique, l'armée irakienne présente son robot mitrailleur

Robots militaires : les États-Unis testent l'efficacité de leurs prototypes dans le Pacifique, l'armée irakienne présente son robot mitrailleur