Google Translate intègre 20 nouvelles langues pour la traduction du texte imprimé,

Google Translate intègre 20 nouvelles langues pour la traduction du texte imprimé, comment l'application s'y prend-elle ?

Google a mis à jour son application Google Translate. Lapplication du numéro un a ajouté à sa liste de connaissances 20 nouvelles langues pour la reconnaissance et la traduction des textes imprimés (le bulgare, le catalan, le croate, le tchèque, le danois, le hollandais, le philippin, le finlandais, le hongrois, lindonésien, le lituanien, le norvégien, le polonais, le roumain, le slovaque, le suédois, le turc et lukrainien) qui viennent compléter les sept langues supportées dans le projet initial (langlais, le français, lallemand, litalien, le portugais, le russe et lespagnol).

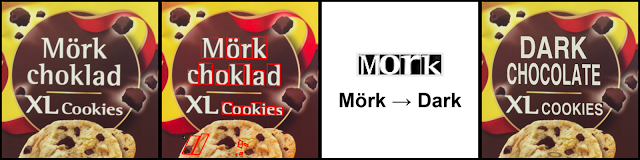

Pour effectuer une traduction, « il vous suffit d'ouvrir l'application, cliquer sur la caméra, et la diriger vers le texte que vous avez besoin de traduire un panneau de signalisation routier, une liste dingrédients, un manuel d'instruction, des boutons de réglages sur une machine à laver. Vous verrez le texte être transformé en direct sur votre écran dans l'autre langue. Aucune donnée cellulaire ni connexion internet nest nécessaire ». La vidéo de démonstration ci-dessous marque lévolution de la vitesse dexécution et de la précision de lapplication depuis lacquisition de la technologie Word Lens suite au rachat de Quest Visual en mai 2014.

Si vous vous demandez comment lapplication fait pour reconnaître et utiliser autant de langages sans avoir besoin dune connexion internet, Mountain View explique que cette prouesse est due à de profonds réseaux neuronaux.

Tout dabord, lorsquune image issue de lobjectif parvient à lapplication, Google Translate commence à y rechercher des caractères. Lapplication a besoin déliminer les objets de fond comme les arbres ou les voitures et ne choisir que les mots à traduire.

Ensuite, Translate doit reconnaître chaque lettre, et cest ici que le deep learning intervient. « Nous utilisons un réseau de neurones à convolution, le formant sur les lettres et les non-lettres de sorte qu'il puisse apprendre à quoi ressemblent les différentes lettres ressemblent », avance Google.

« Mais, fait intéressant, si nous ne le formons que sur des lettres dapparence très "correcte", nous risquons de ne pas comprendre ce à quoi les lettres ressemblent dans la réalité. Les lettres dans le monde réel sont entachées par des réflexions, la saleté, des taches et toutes sortes de bizarreries. Donc, nous avons conçu notre générateur de lettres afin quil puisse créer toutes sortes de fausse " saleté " pour imiter de façon convaincante le caractère bruyant des réflexions du monde réel fausses réflexions, fausses taches, fausses bizarreries tout autour. Pourquoi ne pas simplement lavoir formé sur les photos de la vie réelle qui comporte des lettres ? Eh bien, il aurait été difficile de trouver assez d'exemples dans toutes les langues dont nous avons besoin, et il est plus difficile encore de maintenir le bon contrôle sur le type dexemples que nous utilisons lorsque nous visons à former un réseau de neurones compact et très efficace. Donc, il est plus efficace de simuler la saleté ».

La troisième étape est de prendre ces lettres que lapplication a reconnues et de les porter au dictionnaire pour traduction. « Étant donné que les étapes précédentes auraient pu échouer de quelque façon que ce soit, la recherche dans le dictionnaire doit être approximative. De cette façon si nous lisons un 'S' comme un '5', nous serons toujours en mesure de trouver le mot 5uper.

Et enfin la dernière étape cest le rendu de la traduction sur lemplacement du mot dorigine. « Nous pouvons le faire parce que nous avons déjà trouvé et lu les lettres dans l'image, donc nous savons exactement où elles sont. Nous pouvons regarder les couleurs entourant les lettres et les utiliser pour effacer les lettres originales. Par la suite, nous pouvons dessiner la traduction au-dessus en utilisant la couleur du premier plan d'origine ».

Source : BlogSpot

Vous avez lu gratuitement 756 articles depuis plus d'un an.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.