Des images de surveillance routière montrent un véhicule Tesla Model S changeant de voie, puis freinant brusquement dans la voie la plus à gauche du pont de la baie de San Francisco, entraînant un carambolage de huit véhicules. Dix-huit personnes ont été affectées par l'accident, neuf adultes et neuf mineurs (dont un enfant de 2 ans) qui ont été traités pour blessures mineures. La circulation sur le pont a été bloquée pendant plus d'une heure.

Des images de surveillance routière montrent un véhicule Tesla Model S changeant de voie, puis freinant brusquement dans la voie la plus à gauche du pont de la baie de San Francisco, entraînant un carambolage de huit véhicules. Dix-huit personnes ont été affectées par l'accident, neuf adultes et neuf mineurs (dont un enfant de 2 ans) qui ont été traités pour blessures mineures. La circulation sur le pont a été bloquée pendant plus d'une heure.La vidéo et les nouvelles photographies de l'accident fournissent le premier aperçu direct de ce qui s'est passé le 24 novembre, confirmant les témoignages de l'époque. Le conducteur a déclaré à la police qu'il avait utilisé la nouvelle fonction "Full Self-Driving" (FSD) de Tesla, note le rapport, avant que le « clignotant gauche de Tesla ne soit activé », que ses « freins ne soient activés », et que la voiture ne se déplace à gauche, « ralentissant à un stop directement sur la trajectoire [du deuxième véhicule] ». La Tesla est passée sur la voie rapide avant de freiner rapidement. La décélération inattendue a ensuite conduit à un carambolage de huit véhicules

Tesla a proposé son FSD en tant qu'option sur ses véhicules, les clients payant jusqu'à 10 000 dollars pour avoir la possibilité d'accéder au logiciel dès sa sortie. Mais des années se sont écoulées depuis l'introduction de cette option, et ce n'est qu'en 2020 qu'un groupe restreint de propriétaires a pu accéder à une version bêta de la fonction.

Si l'expression Full Self-Driving, littéralement « conduite autonome intégrale », laisse peu d'ambiguïté quant à ses aspirations, la technologie accomplit bien moins que ce que les mots impliquent. La FSD serait en fait une version sophistiquée de l'assistance au conducteur de niveau 2, telle que définie par SAE International, arbitre de nombreuses normes automobiles mondiales.

Bien que toujours en bêta, le prix du FSD a, quant à lui évolué : il coûtait 5 000 $ au lancement. Mais lorsque Tesla a commencé à déployer la version bêta de FSD auprès d'un groupe restreint de clients en octobre 2020, le prix est passé à 10 000 $. En septembre 2021, Tesla a commencé à ouvrir la version bêta à davantage de clients via un nouveau bouton « demande » avant d'augmenter le prix à 12 000 $ plus tôt en 2022. Puis, en août 2022, Elon Musk a annoncé que le prix allait passer à 15 000 dollars en Amérique du Nord le 5 septembre 2022 :

Il faut noter que cette annonce triomphante d'Elon Musk sur Twitter a été faite quelques heures avant l'accident. À la fin de l'année dernière, Tesla avait déployé la fonctionnalité auprès de plus de 285 000 personnes en Amérique du Nord, selon la société.

La NHTSA a ouvert une enquête sur l'incident

La National Highway Traffic Safety Administration, ou NHTSA, a déclaré qu'elle ouvrait une enquête sur l'incident. Les véhicules Tesla utilisant son système d'assistance à la conduite Autopilot ont été impliqués dans 273 accidents connus de juillet 2021 à juin de l'année dernière, selon les données de la NHTSA. Teslas représentait près de 70% des 329 accidents dans lesquels des systèmes avancés d'assistance à la conduite étaient impliqués, ainsi qu'une majorité de décès et de blessures graves qui leur sont associés, selon les données. Depuis 2016, l'agence fédérale a enquêté sur un total de 35 accidents dans lesquels les systèmes "Full Self-Driving" ou "Autopilot" de Tesla étaient probablement utilisés. Ensemble, ces accidents ont conduit à la mort de 19 personnes.

Pour ceux qui se demandent quelle est la différence entre Autopilot et Full Self-Driving, voici quelques points clés :

- Tesla Autopilot est un système d'aide à la conduite conçu pour la conduite sur autoroute. Full Self-Driving (FSD) est le système (supposé) entièrement autonome de Tesla conçu pour la conduite urbaine.

- Autopilot est un système d'assistance à la conduite. Il utilise des capteurs et des caméras pour aider le conducteur à rester dans sa voie, à changer automatiquement de voie, à tourner dans les virages et à s'arrêter en toute sécurité en cas d'urgence. Autopilot peut également garer votre véhicule ou vous l'amener depuis une place de stationnement.

- FSD fonctionne sur toutes les routes dans toutes les conditions (sur le papier), de jour comme de nuit. Il ne nécessite aucune intervention de votre part pour se conduire, mais il a besoin que vous soyez prêt à tout ce qui pourrait arriver, car il vous alertera si quelque chose se produit de manière inattendue afin que vous puissiez prendre le contrôle de votre véhicule si nécessaire.

- FSD est une fonctionnalité plus récente qui vous permet de conduire votre voiture en mode mains libres. Il comprend la direction automatique améliorée, où vous pouvez définir une destination et la voiture vous y conduira automatiquement.

- Autopilot est livré avec chaque Tesla et peut être utilisé directement. FSD est une mise à niveau de 15 000 $ disponible uniquement aux États-Unis et n'est actuellement pas légale.

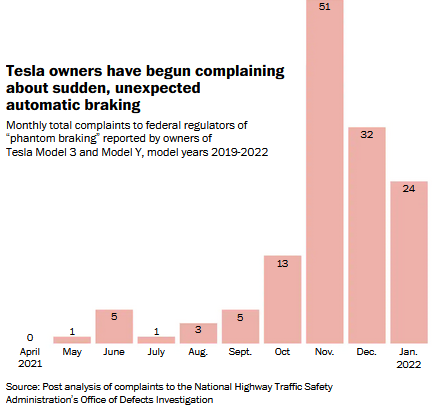

Ces derniers mois, une vague de rapports est apparue dans laquelle les conducteurs de Tesla se sont plaints d'un « freinage fantôme » soudain lorsque le véhicule est à grande vitesse, provoquant presque des accidents dans de nombreux cas. Plus de 100 plaintes de ce type ont été déposées auprès de la NHTSA en trois mois, selon le Washington Post.

Le quotidien explique que :

Teslas freine de manière inattendue en réponse à des dangers imaginaires tels que la circulation venant en sens inverse sur des routes à deux voies ce qui a incité leurs propriétaires terrifiés à déposer une vague de plaintes auprès de la National Highway Traffic Safety Administration au cours des trois derniers mois, selon une analyse du Washington Post des données fédérales sur la sécurité automobile.

Le phénomène, connu sous le nom de « freinage fantôme », est un problème persistant pour les véhicules Tesla.

Le constructeur automobile a été contraint de rappeler une version de son logiciel Full Self-Driving en octobre en raison de faux positifs de son système de freinage d'urgence automatique qui, selon lui, ont été déclenchés par la mise à jour logicielle. Les plaintes ont grimpé en flèche après le rappel et restent élevées, signalant l'inquiétude continue des propriétaires.

Les rapports de propriétaires de freinage fantôme à la NHTSA sont passés à 107 plaintes au cours des trois derniers mois, contre seulement 34 au cours des 22 mois précédents.

Le phénomène, connu sous le nom de « freinage fantôme », est un problème persistant pour les véhicules Tesla.

Le constructeur automobile a été contraint de rappeler une version de son logiciel Full Self-Driving en octobre en raison de faux positifs de son système de freinage d'urgence automatique qui, selon lui, ont été déclenchés par la mise à jour logicielle. Les plaintes ont grimpé en flèche après le rappel et restent élevées, signalant l'inquiétude continue des propriétaires.

Les rapports de propriétaires de freinage fantôme à la NHTSA sont passés à 107 plaintes au cours des trois derniers mois, contre seulement 34 au cours des 22 mois précédents.

Un carambolage de huit voitures le 24 novembre 2022 sur le Bay Bridge de San Francisco

Alors que les constructeurs automobiles traditionnels entrent sur le marché des véhicules électriques, Tesla est de plus en plus sous pression pour se différencier. L'année dernière, Musk a déclaré que Full Self-Driving était une fonctionnalité « essentielle » à développer pour Tesla, allant jusqu'à dire : « C'est vraiment la différence entre Tesla qui vaut beaucoup d'argent ou qui vaut pratiquement zéro ».

Le terme Full Self-Driving critiqué par d'autres constructeurs automobiles

Le terme "Full Self-Driving" a été critiqué par d'autres fabricants et groupes industriels comme trompeur et même dangereux. L'année dernière, la société de technologie de conduite autonome Waymo, détenue par la société mère de Google, a annoncé qu'elle n'utiliserait plus le terme.

« Malheureusement, nous constatons que certains constructeurs automobiles utilisent le terme 'self-driving' [ndlr. auto-conduite] de manière inexacte, donnant aux consommateurs et au grand public une fausse impression des capacités de la technologie d'assistance à la conduite (pas entièrement autonome) », a écrit Waymo dans un billet de blog. « Cette fausse impression peut amener quelqu'un à prendre sans le savoir des risques (comme retirer ses mains du volant) qui pourraient mettre en péril non seulement sa propre sécurité, mais aussi celle des personnes qui l'entourent ».

Bien que Waymo ne nomme aucun nom, la déclaration semble clairement motivée par la décision controversée de Musk d'utiliser le terme Full Self Driving.

Dans le même ordre d'idées, le premier groupe de pression pour les voitures autonomes est récemment passé de l'appellation « Self-Driving Coalition for Safer Streets » à « Autonomous Vehicle Industry Association ». Le changement, a déclaré le groupe industriel, reflétait son « engagement envers la précision et la cohérence dans la façon dont l'industrie, les décideurs, les journalistes et le public parlent de la technologie de conduite autonome ».

Le secrétaire aux Transports, Pete Buttigieg, a également critiqué les technologies émergentes d'assistance à la conduite, qui, selon lui, n'ont pas remplacé le besoin d'un conducteur humain alerte : « Je n'arrête pas de le dire ; tout ce que vous pouvez acheter sur le marché aujourd'hui est une technologie d'assistance à la conduite, pas une technologie de remplacement du conducteur », a déclaré Buttigieg. « Je me fiche de comment ça s'appelle. Nous devons nous assurer que nous sommes parfaitement clairs à ce sujet, même si les entreprises ne le sont pas ».

Bien que le langage puisse évoluer, il n'y a toujours pas de restrictions fédérales sur les essais de véhicules autonomes sur la voie publique, bien que les États aient imposé des limites dans certains cas. Tesla n'a annoncé aucun changement au programme ou à son image de marque, mais le crash était l'un des multiples ce mois-là. Plusieurs jours avant l'accident de Bay Bridge, le 18 novembre dans l'Ohio, une Tesla Model 3 s'est écrasée contre un SUV de l'Ohio State Highway Patrol arrêté dont les feux de détresse clignotaient. La Tesla est également soupçonnée d'avoir été en mode Full Self-Driving et fait également l'objet d'une enquête de la NHTSA.

Sources : rapport détaillé de l'incident (au format PDF), Elon Musk, Washington Post

Et vous ?

Aviez-vous déjà entendu parler de ce phénomène de « freinage fantôme » ?

Aviez-vous déjà entendu parler de ce phénomène de « freinage fantôme » ?  Que suggère-t-il selon vous concernant Autopilot et Full Self-Driving ?

Que suggère-t-il selon vous concernant Autopilot et Full Self-Driving ? Pour ou contre les dénominations Autopilot et Full Self-Driving ? Pourquoi ?

Pour ou contre les dénominations Autopilot et Full Self-Driving ? Pourquoi ? Que pensez-vous de la sortie de Waymo, un concurrent de Tesla, qui tacle au passage ces dénominations ?

Que pensez-vous de la sortie de Waymo, un concurrent de Tesla, qui tacle au passage ces dénominations ?