Google permet désormais à des partenaires de signaler les contenus choquants ou offensants

Google permet désormais à des partenaires de signaler les contenus choquants ou offensants dans ses résultats de recherche

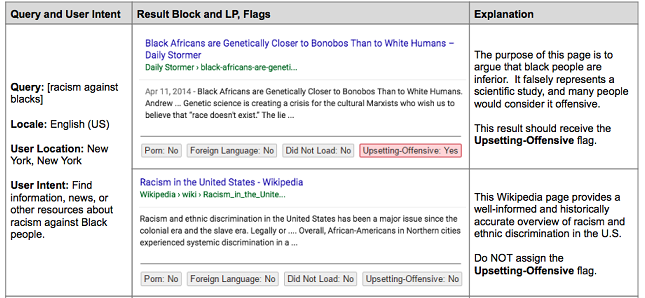

Google a décidé de suivre une nouvelle politique de filtrage des informations qui transitent sur ses serveurs. La firme américaine souhaite s'attaquer aux propos à caractère discriminatoire, haineux ainsi qu'à la publication d'informations fausses. C'est dans ce but qu'elle travaille en collaboration avec des milliers de sous-traitants et de modérateurs venant des quatre coins de la planète afin d'analyser et d'affiner ses résultats de recherche. Google a mis à leur disposition un bouton « Upsetting - Offensive » pour leur permettre de signaler tous les résultats de recherche qui correspondent aux types de données qu'il veut faire disparaître.

Les critères d'évaluation

La nouvelle ambition de Google est de filtrer les informations à caractère discriminatoire, haineux et la publication d'informations fausses. Cette volonté est matérialisée par la mise en place d'une série de règles qui sont destinées à être testées pendant les opérations d'évaluation. Les informations de propagande encourageant l'incitation à la haine, le racisme, l'antisémitisme, l'islamisme, le harcèlement en ligne, la violence en ligne, la suprématie blanche et le nazisme seront les cibles privilégiées de cette opération. Grâce à ces règles, les modérateurs pourront séparer le bon grain du mauvais et préparer la relève technologique. Dans un guide dédié à ses partenaires, Google donne des exemples pour montrer dans quels cas il faudrait signaler ou non un contenu.

Préparer Perspective, lIA de Google pour la détection de propos « toxiques » en ligne

L'objectif de cette opération, c'est de préparer le nouveau dispositif en ligne de détection des commentaires toxiques de Google. Cet outil de modération contrôlé par une IA maison de Google a déjà été évoqué dans nos articles précédents. Elle porte le nom de Perspective. Son rôle sera de bloquer la diffusion des contenus qui ne respectent pas les nouvelles dispositions éthiques et morales éditées par Google, et favoriser la publication de commentaires et de discussions "propres" sur les plateformes. Le logiciel effectuera une vérification des commentaires en leur attribuant une note de 1 à 100 par ordre de gravité (bon commentaire contre commentaire inacceptable). Les utilisateurs pourront même être avertis que leur commentaire est inapproprié et susceptible d'être supprimé s'ils ne le modifient pas. Sur le long terme, tout cela devrait faciliter le travail des modérateurs de sites, permettre à l'algorithme de traitement d'être plus efficace et pertinent dans ses choix. Tout ceci dans l'espoir de rendre internet et ses internautes plus sains.

Sources : Search Engine Land, Le Figaro

Et vous ?

Qu'en pensez-vous ?

Qu'en pensez-vous ? Y voyez-vous une restriction de la liberté d'expression sur internet ?

Y voyez-vous une restriction de la liberté d'expression sur internet ? Quelles sont les limites de ce système ?

Quelles sont les limites de ce système ?Voir aussi

Perspective, l'IA de Google pour détecter les propos déplacés en ligne est bien loin d'être mature, des chercheurs mettent en évidence ses lacunes

Perspective, l'IA de Google pour détecter les propos déplacés en ligne est bien loin d'être mature, des chercheurs mettent en évidence ses lacunes

Vous avez lu gratuitement 598 articles depuis plus d'un an.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.