Face2Face : une application qui permet de truquer des vidéos en temps réel

Face2Face : une application qui permet de truquer des vidéos en temps réelen modifiant en direct les expressions du visage de la cible

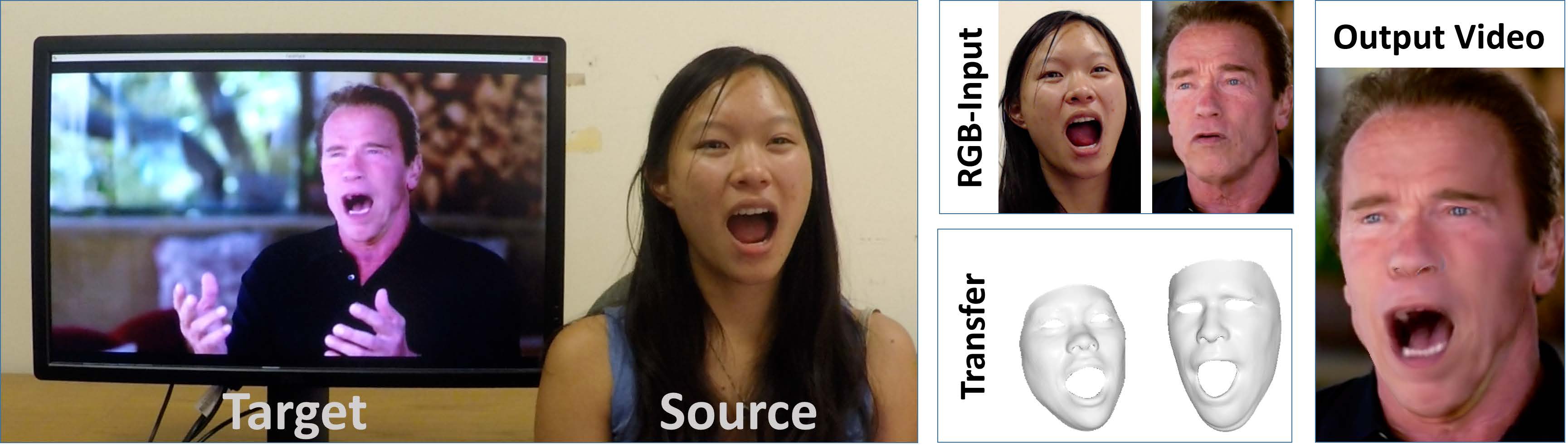

Des chercheurs de Stanford University, University of Erlangen-Nuremberg et Max-Planck-Institute for Informatics, ont développé une application baptisée Face2Face. Celle-ci met en évidence des progrès significatifs dans le domaine de la modélisation 3D pour la reconstitution faciale. Avec leur application, les chercheurs mettent en uvre une nouvelle approche de reconstitution en temps réel du visage dune vidéo.

Face2Face permet à un acteur danimer en direct les expressions dun visage dans une vidéo cible. Pour cela, lacteur capture à partir de sa webcam les expressions faciales de son propre visage quil veut faire paraître sur le visage de sa cible. Lapplication se charge ensuite de transférer ces expressions de manière rapide et efficace sur le visage de la cible en direct, et la vidéo cible est reconstituée en temps réel.

Contrairement aux approches de reconstitution faciale existantes qui fonctionnent en mode hors connexion, celle utilisée par ces chercheurs vise à transférer en ligne des expressions faciales dun acteur source vers un acteur cible. Les chercheurs utilisent également une caméra équipée dun simple capteur RVB plutôt quune caméra équipée dun capteur de profondeur.

Leur objectif est de modifier la vidéo cible de manière photo-réaliste, de telle sorte quil soit pratiquement impossible de remarquer les manipulations. Les chercheurs ont démontré leur méthode dans une configuration en direct, où des vidéos YouTube ont été reconstituées en temps réel.

Sources : Stanford, Face2Face: Real-time Face Capture and Reenactment of RGB Videos (pdf)

Et vous ?

Quen pensez-vous ?

Quen pensez-vous ?Voir aussi :

Un étudiant développe un programme de capture de mouvements, Predator est sous licence GPL et ne demande qu'une Webcam

Un étudiant développe un programme de capture de mouvements, Predator est sous licence GPL et ne demande qu'une Webcam

Vous avez lu gratuitement 1 233 articles depuis plus d'un an.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.